最近よく、業務へのAIの導入や、活用に関して相談を受けることも多い。

生成AIの利用に関しては、個人利用率が先進国の中でも日本が圧倒的に低いらしい。

私が日々業務で関わる人々はエンジニアやマーケターの方が多いので比較的普及しているように感じるが、

部署や事業が変われば取り巻く環境や担当者のリテラシーが全く変わってくると実感している。

ましてや比較的レガシーな企業においては、さらにこの格差は大きいだろう。

実際に個人での利用は日本は9%程度※にとどまっているようだ。

一方で中国(56.3%)、米国(46.3%)、英国(39.8%)、ドイツ(34.6%)と大きく差が開いている。

※出典:日本経済新聞/生成AIの個人利用、日本は9%どまり 中国・米国と大差

日本でなぜAIが普及しないのか

消費者や労働者視点で考えてみよう

ミクロな視点からまずは考えてみたい。

消費者の視点で見るといくつかポイントがありそうだ。AIに関して、実態や中身が見えにくい(イメージしにくい)ことで、言い知れぬ怖さや怪しさがあると考える人も多いのではないだろうか。

1. 使い方がわからない

AIや関連する技術の概念や操作が一般的に理解されていない場合が多く、例えば、AIを活用したサービスやアプリがどのように機能しているのか、何ができるのかが曖昧なため、実際に使うまでに至らないことがある。

使用してみるまでは、得られるアウトカムを抽象的にしか理解しにくいため、ハードルが低く現状維持バイアスが働き、現状の手法を変えないという選択を取る人たちが多い。

2. 生活に必要ないと感じる

AIの利便性が実感されにくく、既存のサービスや手作業で十分に生活が成り立っていると感じる人々にとって、AIを導入するメリットが見えにくい。

最初のハードルを乗り越え、すごく小さなタスクを実行してみると、利便性がイメージしやすくなる。

例えばPDFをテキストコピーすると改行や文字化けが起こるが、Chatgptを使えば簡単にテキストファイルにしてくれる。不思議なことに一つやらせてみると、他の軽作業についても依頼するハードルが下がる。そこから自分なりのユースケースを広げていくことができるのだ。

3. 新しい技術に対する抵抗感

AIは比較的新しい技術であるため、多くの人にとっては未知の存在であり、それらを構成する技術に対して漠然とした不安感を抱くことが多い。AIが生活や仕事にどのように影響するかが明確に伝わっていないため、積極的に活用しようとする動機づけが少ない。

マクロな視点から考えてみる

2000年当時のIT革命の時代に、その波に乗り遅れた企業が多く、世界的な波に乗れなかったことで多くの外資系テクノロジー企業が日本に参入し、テクノロジー領域で世界に遅れをとったように思う。

本質的には、近年のAIの台頭にはそれに近い動きを感じる。

さらにAIは基本的にデジタルの下支えがあって初めて実現する。前述のIT革命期での遅れは足枷になっている。いわば、基礎工事がなされていない状態で家を建てようとしてもうまくいかないように思う。

1. 労働文化と職場慣習

日本では、従来からの職場慣習が根強く残っている。AIや自動化の導入によって業務が効率化される一方で、終身雇用や年功序列といった制度のもと、労働者の役割が変わることに抵抗感があるのだ。AIが仕事を奪うのではないかという懸念や、人的サービスを重視する文化がAI導入のペースを遅らせる要因の一つかもしれない。

2. デジタルインフラと技術教育の遅れ

AIの導入には高度なデジタルインフラと技術教育が必要だ。しかし、前述の通り日本では中小企業などを中心にデジタル化の遅れが指摘されており、AIを導入するための基盤が整っていない場合が多い。さらに、ITやデジタルスキルを持つ労働力の不足も、AI普及の妨げとなっているだろう。

3. 規制や法的制約

AIの利用に関してはプライバシーやセキュリティに関する規制が厳しい場合がある。

EUなどではAIの規制法成立し、日本にも同じ流れが来るだろう。

欧州AI規制法では、AIシステムのリスクに基づいて規制の厳しさを段階的に設定しており、4つのリスクカテゴリーがあり、許容できないリスク〜最小限のリスクでそれぞれ異なる規制が適用される。

特に個人データの保護に関する法律(個人情報保護法など)が強化されており、AIの活用範囲が制限される。企業が法的リスクを避けるため、AI導入に慎重になることも一因だろう。

日本においてAIを普及させつつ、安全性や信頼性の確保の両軸で企業の自主規制と法的な規制を整備していく必要がある。

4. 言語の壁

多くのAIは英語で開発・提供されている。日本語は特殊な言語であり、その自然言語処理(NLP)技術の開発は他言語に比べて難易度が高いとされており、従来自然言語処理をした広告のターゲティングなどは、前処理として一度英語に翻訳されてから活用されているケースもある。そのため、日本語対応のAI技術が他国語対応のものと比べて遅れているという問題がある。

5. 社会的な受容性

日本では様々な分野で新しい技術に対する慎重な姿勢が見られる。

また、AIを活用するための具体的なビジネスケースや成功事例が少ないことも、AI導入への積極的な姿勢を後押しする材料にはなりにくいのかもしれない。

ではAI先進国となぜ差が開いているのか

ではなぜ中国はここまでAIの社会実装が進んでいるのか。

中国政府の政策やインフラ、社会、文化的な環境が大きく関係していそうだ。

1. 政府の強力な政策支援

中国政府は、AIを国の競争力を高める戦略的な分野と位置付けており、中国国務院が2017年に発表した、「次世代AI発展計画」では、2020年までにAI製品の大量生産、基礎能力の全面強化、開発支援体制の強化などを行う『3年行動計画』などが示されて実行されてきた。

2. プライバシーの侵害

中国住宅建設省が管轄するものだけで、全国に290都市あるスマートシティでは、街のインフラがほぼAIで機能しているそうだ。ドローンや町中に設置されたカメラが渋滞や事故の検出を速やかに行い、リアルタイムで信号を最適化することなども可能だ。

日本であれば、利便性よりも個人情報の保護などが注目されそうであるが、そういった社会・文化の違いも、社会実装のスピードへは大きく影響しそうだ。

AI普及の負の面

一方でAI普及には負の面も存在する。

1. 雇用の減少

どの立場に立つかで”負”にも”正”にもなりうるが、AIの導入により、自動化が進むことで特定の仕事が失われるリスクがある。特にルーチンワークや単純作業を中心とした職種は、AIやロボットによって代替されやすく、これにより一部の業種や労働者が失業の危機にさらされる可能性がある。一方で企業にとっては、従業員の管理、教育のコスト削減、危険な作業の自動化やアクシデントへの対応など様々な面でメリットがあるだろう。

2. プライバシーの侵害

AI技術が進化する中で、個人データの収集・分析が非常に容易になった。これにより、プライバシーの侵害リスクが増加する。例えば、顔認識技術や行動追跡技術が個人のプライバシーを侵害し、監視社会化が進む懸念がある。

3. バイアスの強化

AIは学習データに依存しているため、データにバイアスが含まれている場合、AIの判断にもそのバイアスが反映される。例えば、人種、性別、年齢に基づく差別的な結果をもたらすこともあるだろう。AIの不適切な運用によって、既存の社会的不平等が強化される可能性も否めない。

4. サイバーセキュリティのリスク

AIが悪意のある目的で使用されることも考えられる。サイバー攻撃を自動化したり、個人情報を不正に取得するためにAIを利用する犯罪などが発生する可能性が高い。また、AI自体が攻撃対象となる場合もあり、安全性が課題となる。

ディープフェイクなどで、動画や音声を偽造する事件や、パスワード解析などは記憶に新しい。

また、犯罪用LLMの界隈では、「脱獄」をサービスとして提供する新たな動き(jailbreak-as-a-service)も確認されているらしい。特殊なプロンプトを使うことでポリシー違反に該当する要求を受け入れさせることも可能になってしまう。

6. 倫理的な問題

AIが意思決定を行う際に、倫理的な判断が難しい場合がある。

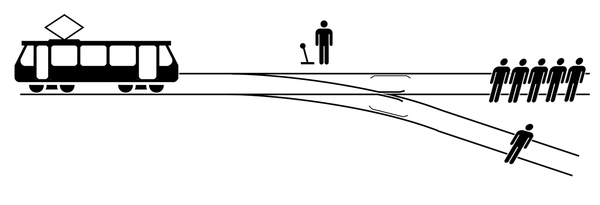

代表的な例としては自動運転技術が発展し、事故を回避する際に1人が歩いている歩道か5人が歩いている歩道のどちらかにハンドルを切らなくてはいけない場合などのある種『トロッコ問題』のようなケースに対して、どのように判断するかが重要な課題になっている。

自動運転車の開発には、倫理的なアルゴリズムの設計が関与しており、自動車メーカーや規制当局は、事故時の行動について何らかのルールを設定する必要があり、「多数の命を救うことを優先する」や「すべての命を平等に扱う」といった選択が考慮される。

現時点でこのような極端な状況に対する明確な基準は定まっておらず、今後の研究と議論が必要になるだろう。

AIの活用は本質的な業務設計である

結論、AIを”遣う”側になるためには、実際に使ってみることである。

遣うことで利便性を認識し、だんだんと

同時に明確に正確に指示を出す力が養われる。あいまいな指示では、回答がずれてしまう為、使えないと感じてしまうだろうが、指示の出し方が悪く、求めている期待値や要件の構造化ができていないユーザー側の問題が大きい。

例えば、スプレッドシートで実現したいことがあるが、関数がイメージがついていない時にいちいちGoogleで調べる必要はなく、Chatgptにデータの構造を共有すればある程度複雑な計算も関数を提案してくれる。

例えば、あるプロジェクトの要件を整理する際に、資料を作成するとしたら、事前にChatgptを使って資料の雛形を生成させてもいい。そうすると、自分が事前にイメージしていた内容に加えて、新たに考慮しておくべき論点なども洗い出してくれることが多い。

また、回答に対して正しく判断する力は重要だ。

まず正確性が求められ、定性的な情報に関してはエビデンスを確認することが必要だ。それらを鵜呑みにして利用することは危険性が高い。自分が理解していなければ質問に対しても回答できないし、深い理解がないと深掘りができない。AIに全て任せるというよりは、AIと共存、共生する意識が重要だと思う。